Ermitteln Sie die optimalen Parameter eines Klassifikators

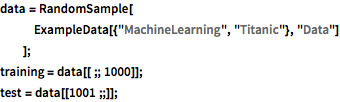

Laden Sie einen Datensatz und teilen Sie ihn in einen Trainingssatz und einen Testsatz auf.

In[1]:=

data = RandomSample[

ExampleData[{"MachineLearning", "Titanic"}, "Data"]

];

training = data[[;; 1000]];

test = data[[1001 ;;]];Definieren Sie eine Funktion, die die Performance eines Klassifikators als eine Funktion ihrer (Hyper-)Parameter berechnet.

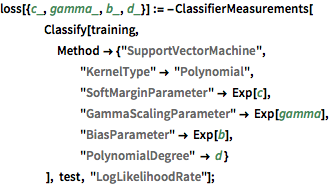

In[2]:=

loss[{c_, gamma_, b_, d_}] := -ClassifierMeasurements[

Classify[training,

Method -> {"SupportVectorMachine",

"KernelType" -> "Polynomial",

"SoftMarginParameter" -> Exp[c],

"GammaScalingParameter" -> Exp[gamma],

"BiasParameter" -> Exp[b],

"PolynomialDegree" -> d }

], test, "LogLikelihoodRate"];Bestimmen Sie den möglichen Wert der Parameter.

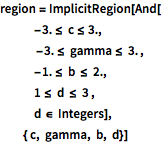

In[3]:=

region = ImplicitRegion[And[

-3. <= c <= 3.,

-3. <= gamma <= 3. ,

-1. <= b <= 2.,

1 <= d <= 3 ,

d \[Element] Integers],

{ c, gamma, b, d}]Out[3]=

Search for a good set of parameters.

In[4]:=

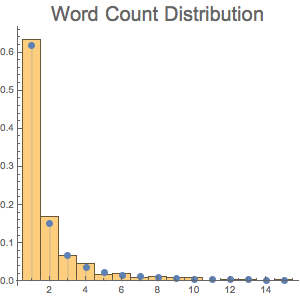

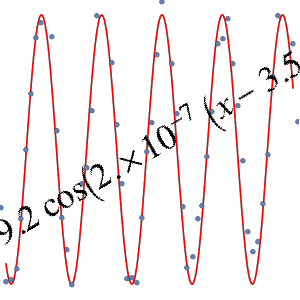

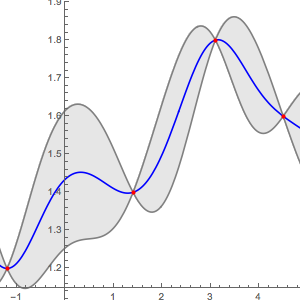

bmo = BayesianMinimization[loss, region]Out[4]=

In[5]:=

bmo["MinimumConfiguration"]Out[5]=

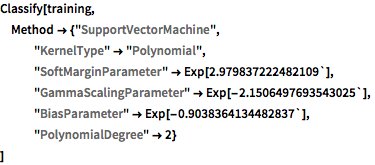

Trainieren Sie mit diesen Parametern einen Klassifikator.

In[6]:=

Classify[training,

Method -> {"SupportVectorMachine",

"KernelType" -> "Polynomial",

"SoftMarginParameter" -> Exp[2.979837222482109`],

"GammaScalingParameter" -> Exp[-2.1506497693543025`],

"BiasParameter" -> Exp[-0.9038364134482837`],

"PolynomialDegree" -> 2}

]Out[6]=