Représentez la sémantique des mots dans leur contexte

Le référentiel Wolfram Neural Net Repository contient de nombreux modèles pour représenter les mots par vecteurs numériques. Ces vecteurs sémantiques représentent un élément clé pour résoudre les applications de langage. Cet exemple présente un modèle d'intégration qui tient compte du contexte de chaque mot et illustre la façon dont il parvient à éliminer toute ambiguïté dans les mots.

Le réseau neuronal ELMo a appris les représentations contextuelles des mots après avoir été entraîné sur environ un milliard de mots.

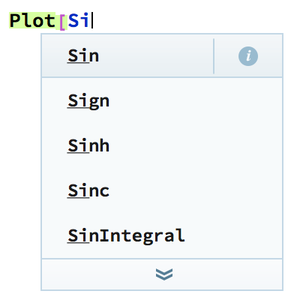

Par défaut, ELMo produit trois vecteurs par mot (un qui n'est pas contextuel et deux de niveau contextuel). Le réseau peut être facilement manipulé pour ne générer qu'un vecteur sémantique pour chaque mot.

Visualisez la sortie du réseau sur un texte (un vecteur de 1024 dimensions pour chaque mot).

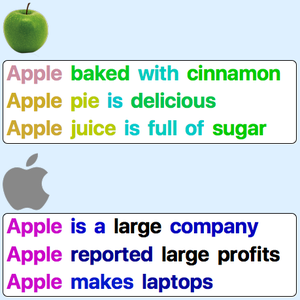

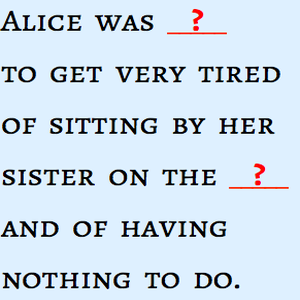

Représentez graphiquement en 2D la représentation sémantique du mot "Apple" dans différents contextes.

Visualisez maintenant la sémantique des mots en utilisant des couleurs.

Implémentez une réduction de dimension 3D à partir de la représentation ELMo.

Créez un réseau qui affiche les couleurs RVB pour chaque mot d'un texte.

Visualisez les couleurs sémantiques des mots dans leur contexte.