为任何语言构建神经网络

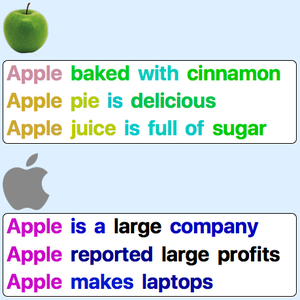

在英语中,将文本标记为单词作为自然语言处理应用程序的第一步通常是有效的:单词是良好的语义单元,并且由于空格和标点符号,它们很容易识别。在其他一些语言中,分词可能更难以执行(例如,中文)或创建过于复杂的语义单元(例如,复合词)。字节对编码(BPE) sub-word tokenization 是可以应用于任何语言的有效替代方案。该范例演示了如何使用参数化 BPE 嵌入模型作为为给定语言创建神经网络的起点。

获取有关 Wolfram Neural Net Repository 中可用的参数化 BPE 嵌入的信息。

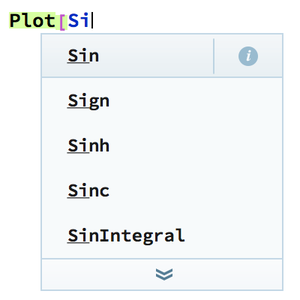

使用非默认参数加载模型。

将嵌入层应用于句子以返回嵌入向量序列(每个sub-word token 对应一个向量)。

提取网络层的 BPE 分词部分。

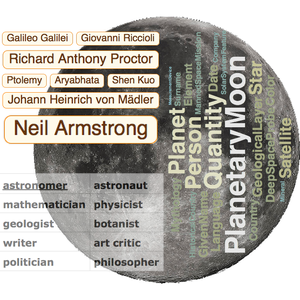

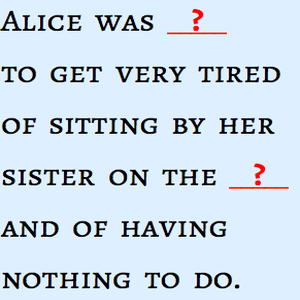

可视化对句子进行分词。

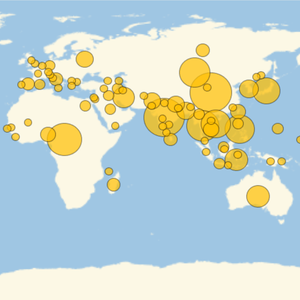

可视化其他语言的分词。

显示完整的 Wolfram 语言输入