다중 GPU에서 네트워크 훈련하기

훈련 시간의 절감을 위해 신경망을 CPU가 아닌 GPU에서 훈련할 수 있습니다. Wolfram 언어는 또한 훈련 속도를 더욱 높이기 위해 동일한 컴퓨터에서 여러 개의 GPU를 사용한 신경망의 훈련을 지원합니다. 다음 예는 T6-CPU의 4-NVIDIA Titan X GPU 시스템에서 훈련을 나타냅니다.

CIFAR-10 훈련 데이터 집합의 부분 집합을 로드합니다.

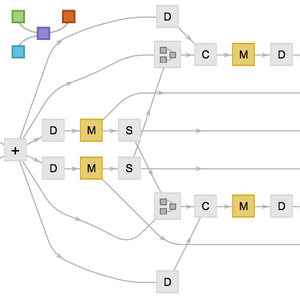

Wolfram Neural Net Repository에서 "Wolfram ImageIdentify Net V1"의 구조를 로드합니다.

네트워크 훈련 속도의 CPU 전처리의 병목 추정을 피하기 위해 네트워크 NetEncoder를 사용하여 입력 데이터를 전처리합니다.

불필요해진 NetEncoder를 제거하고 네트워크 헤드와 최종 NetDecoder를 대체하여 서로의 데이터 집합에서 클래스와 일치 하도록합니다.

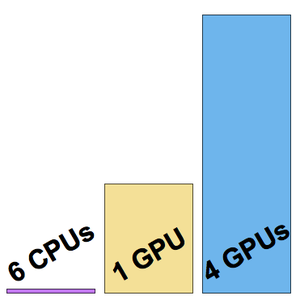

6코어 CPU를 탑재한 기기로 훈련을 시작합니다.

이 훈련은 초당 8번의 속도로 실행됩니다.

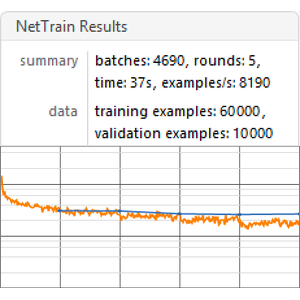

단일 GPU(표시를 담당하는 GPU의 사용은 권장하지 않으므로 네 번째 것)로 훈련을 시작합니다.

이번 훈련은 1초에 200 예의 속도로 이루어졌습니다.

다음 네 개의 GPU로 훈련을 시작합니다.

이번 훈련 속도는 1초에 약 500 예입니다.

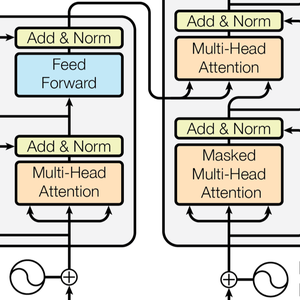

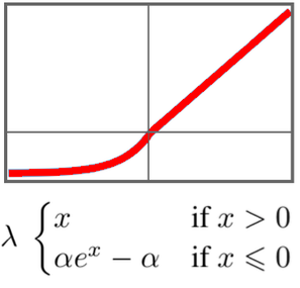

측정된 세 가지 훈련 속도를 시각화합니다.